In sintesi: scenari, criticità e veri casi studio

L’intelligenza artificiale ha superato la fase di hype per diventare un elemento strutturale nel marketing e nella comunicazione. Per ottenere un reale ROI, le aziende devono abbandonare l’improvvisazione, adottare un approccio scientifico per scalare i Proof of Concept, ottimizzare i contenuti per i motori generativi (GEO) e investire nel change management del team. Al convegno “Megatrends 2026: beyond the hype. L’IA nelle aziende tra futuro reale e bubbles tecnologiche” tenutosi il 16 aprile scorso presso la facoltà di Economia dell’Università Tor Vergata, i relatori hanno raccontato trend e rischi, presentando studi e casi studio attualissimi.

Intelligenza artificiale nel marketing e nella comunicazione

L’integrazione dell’intelligenza artificiale all’interno delle dinamiche aziendali, in particolare per i dipartimenti marketing, comunicazione e customer care, rappresenta oggi una rivoluzione tangibile, non più una proiezione futura. Durante un recente e approfondito dibattito tenutosi presso l’Università Tor Vergata di Roma, guidato da accademici e leader di settore, è emerso un quadro estremamente lucido e, a tratti, critico sullo stato di adozione di queste tecnologie in Italia.

Martina Conticelli, direttrice del dipartimento di management e diritto dell’Ateneo, ha introdotto i lavori evidenziando un aspetto fondamentale per i giuristi: i social network e le piattaforme alimentate dall’AI rappresentano oggi un vero e proprio “non-luogo”, uno spazio dalle regole opache che simula dinamiche sociali organizzate. Richiamando una nota affermazione secondo cui “Facebook è uno Stato”, ha sottolineato la pericolosità e la pervasività di questi strumenti, ricordando che per sopravvivere e operare in modo significativo è vitale conoscere a fondo non solo le potenzialità, ma anche i pericoli a cui ci espongono.

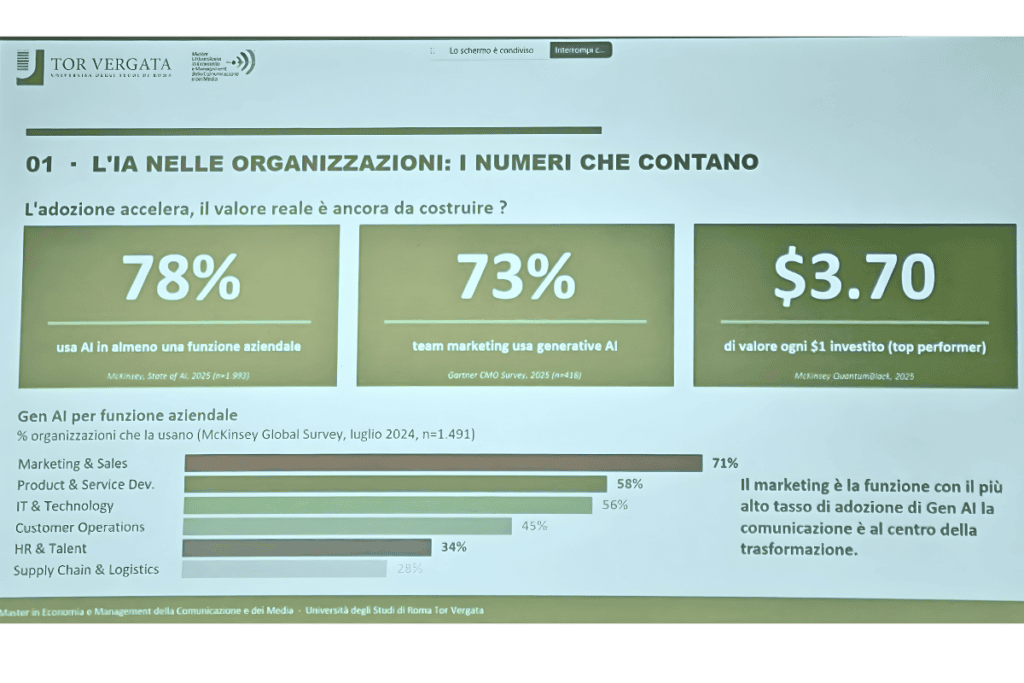

Sulla stessa linea, Simonetta Pattuglia, direttrice del master in economia e management della comunicazione e dei media, ha invitato la platea a uscire dal duopolio emotivo composto da “grandissima enfasi e grandissimo senso del pericolo”. L’obiettivo per le organizzazioni, siano esse enti pubblici o imprese private, è comprendere a che punto siamo realmente. Analizzando i dati di mercato, è evidente che l’AI sia già fortemente implementata nelle funzioni di marketing e comunicazione, sfatando il mito che la “creatività” umana fosse intoccabile. Al contrario, laddove l’AI arriva, spinge i creativi a dover essere molto più preparati per evitare un pericoloso appiattimento e l’omologazione dei contenuti. La vera sfida risiede nel change management e nel reskilling continuo dei dipendenti, operando cambiamenti profondi ma preservando l’autenticità del brand, vero baluardo contro la standardizzazione algoritmica.

La fine dell’hype: metodo scientifico e fallimento dei progetti AI

Se il dibattito pubblico è ancora intrappolato nella fascinazione per l’AI, chi opera sul campo racconta una realtà profondamente diversa e più complessa. Claudio Stamile, manager of AI R&D & market solutions per Fastweb e Vodafone, ha offerto un punto di vista ingegneristico e pragmatico, criticando aspramente l’impoverimento del dialogo tecnologico, ormai ridotto a meme o a test superficiali sulle piattaforme social. Nonostante l’apparente entusiasmo generale, in Italia vi è un profondo divario tra le parole e i fatti: “Tanti parlano, pochi fanno, e in Italia è un pattern ricorrente”, confermato dai bassi tassi di utilizzo reale dei tool generativi registrati da Eurostat.

Uno dei nodi centrali e più critici sollevati da Stamile riguarda il ciclo di vita dei progetti AI nelle aziende. Attualmente, le imprese investono decine di migliaia di euro in cosiddetti POC (Proof of Concept) solo per dimostrare che “il concetto funziona”. Tuttavia, l’85% di questi POC fallisce miseramente quando si tenta di scalarli nei processi aziendali quotidiani. Il fallimento è quasi sempre da imputare a ragioni di business, non tecnologiche: i vertici aziendali avviano progetti per puro “hype” o per generare un ritorno d’immagine (spesso annunciato in pompa magna su LinkedIn), scoprendo solo in seguito che i dipendenti non utilizzano il tool perché non risolve alcun problema reale e non genera alcun guadagno o risparmio tangibile.

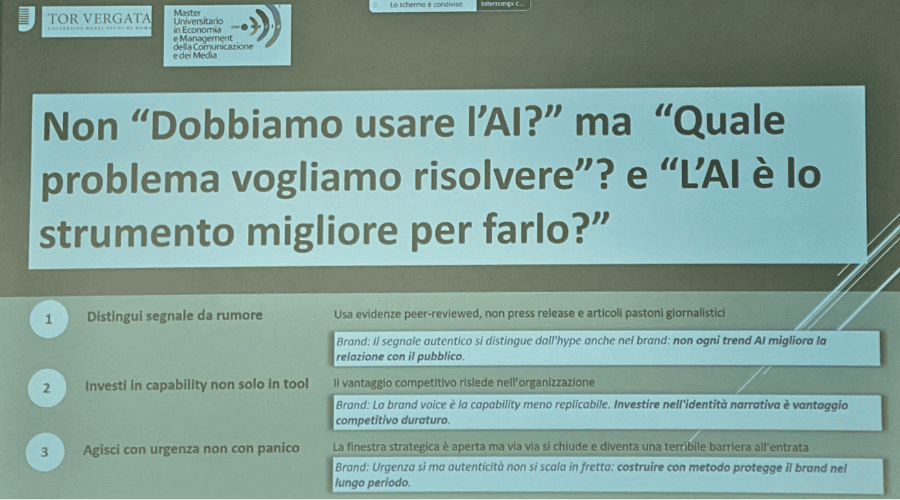

La soluzione a questa deriva è il ritorno rigoroso al metodo scientifico applicato al business: partire da un problema reale e doloroso (come l’analisi manuale di 50 file Excel al giorno), sviluppare la soluzione tecnologica e misurarne meticolosamente l’impatto economico. L’intelligenza artificiale, se usata bene, si trasforma in quello che Stamile definisce “Welfare AI”, uno strumento che solleva l’essere umano dai lavori bruti, ripetitivi e de-motivanti, restituendo valore e creatività al lavoratore. Qualsiasi delega incondizionata all’AI, senza accountability e controllo umano, equivale ad “aumentare un punto di fallimento” per l’intera organizzazione.

L’evoluzione verso gli agenti multipli e l’importanza del contesto aziendale

Mattia De Rosa, cloud solutions architect director & AI platform di Microsoft, ha spostato l’attenzione sulle frontiere architetturali dell’intelligenza artificiale. Se fino a pochi anni fa si inseguiva l’utopia della “singolarità” — un’unica super-intelligenza onnisciente —, oggi l’industria si sta muovendo verso la “società dei pensieri”, ovvero ecosistemi di agenti AI specializzati che dialogano, si controllano a vicenda e raggiungono un accordo prima di fornire una risposta all’utente.

L’evoluzione dei grandi modelli linguistici (LLM) ha seguito due binari paralleli: da un lato una crescita esponenziale delle capacità cognitive e della mole di parametri, dall’altro un abbattimento drastico dei costi computazionali, crollati del 97% negli ultimi anni, con l’obiettivo strategico da parte dei colossi tech di portare il costo di utilizzo prossimo allo zero.

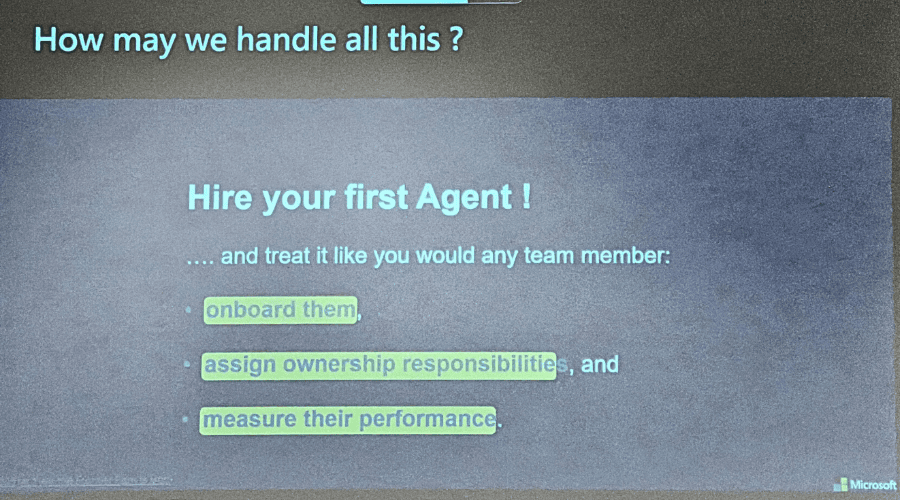

Tuttavia, anche i modelli più sofisticati falliscono per un motivo strutturale: mancano del contesto specifico della singola realtà aziendale. Un modello generale non conosce i processi, il gergo, la documentazione storica o la gerarchia di una specifica impresa. Per questo motivo nascono gli Enterprise Agent, sistemi integrati verticalmente sui dati proprietari. L’innovazione procedurale proposta da De Rosa è paragonabile all’assunzione di un nuovo dipendente: un agente AI non può essere semplicemente acceso e lasciato a sé stesso, ma necessita di un vero e proprio “onboarding”, in cui gli si definiscono responsabilità, limiti d’azione, colleghi di riferimento e fonti di consultazione, monitorando costantemente l’effettivo raggiungimento dei risultati. Questo richiede nuove skill manageriali per gestire team composti non solo da esseri umani, ma anche da agenti sintetici (il concetto di team centauro).

Il funerale del piano editoriale e l’AI come gatekeeper dei social media

Marco Massarotto, social & content lead di Accenture Song, ha dipinto un quadro in profonda mutazione per quanto riguarda il social media marketing, dichiarando senza mezzi termini il “funerale del piano editoriale”. La pratica storica di pianificare post a gennaio, pubblicarli a febbraio e analizzarli a marzo è divenuta un approccio obsoleto e fallimentare, paragonato a un “morto che cammina”.

Oggi, l’algoritmo governato dall’intelligenza artificiale agisce come l’arbitro insindacabile e il “gatekeeper” assoluto tra i contenuti del brand e il consumatore finale. Nel tempo zero della pubblicazione, l’AI scansiona il contenuto, ne radiografa intenti, testi e immagini, analizza lo storico dei comportamenti degli utenti e decide probabilisticamente se e a chi mostrarlo. Per sopravvivere a questo filtro, le agenzie e i dipartimenti marketing devono costruire un ecosistema fluido, un vero e proprio “content system” capace di intercettare dinamicamente le reali intenzioni (needs) e i momenti (personas) degli utenti.

Massarotto ha evidenziato come sia necessario combinare un livello di contenuti fondazionali (always-on), che insegni all’algoritmo l’identità del brand, con una fortissima capacità reattiva (real-time marketing) per cavalcare i trend emergenti. Esempi virtuosi includono strategie basate su insight profondi, come la copertura social del Festival di Sanremo realizzata per Barilla (senza l’uso di keyword esplicite legate all’evento per vincoli di sponsorship), o l’innovativa campagna di sound tourism per Amplifon, che hanno generato performance organiche doppie o triple rispetto agli standard aziendali. In questo panorama, l’AI è essenziale per orchestrare velocemente i dati, ma se usata solo come “content factory” per produrre enormi quantità di materiali privi di rilevanza contestuale, diventa inutile. Massarotto ha inoltre allertato la platea sul duplice rischio sociologico: da un lato l’algoritmo può radicalizzare le opinioni orientando l’informazione (chiudendo gli utenti in “filter bubbles”), dall’altro espone l’essere umano a una pericolosa “debilitazione cognitiva”, delegando sempre più spesso la fatica della decisione alla macchina.

Dalla SEO alla GEO: i motori di ricerca generativi e il posizionamento cognitivo

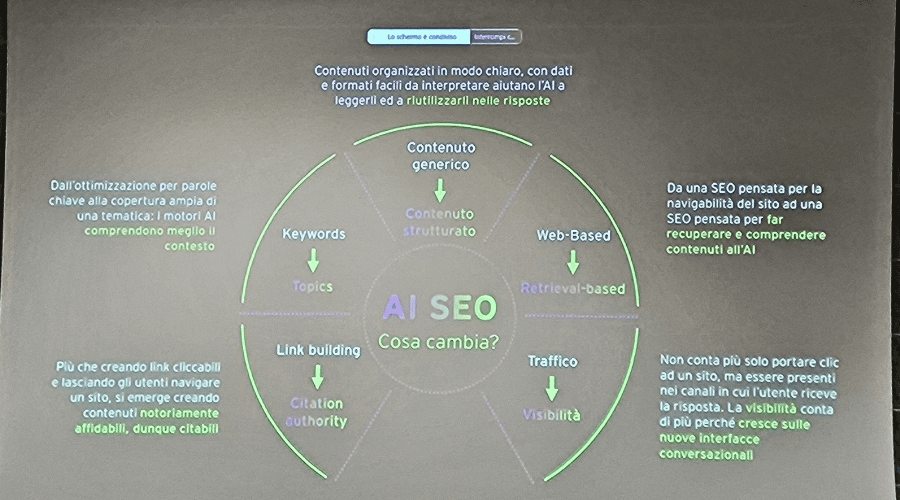

L’evoluzione descritta in ambito social trova un parallelo perfetto nel comparto del search marketing, analizzato da Marzia Del Prete, senior manager AI & Data di EY. Per decenni, l’utente ha interrogato Google tramite stringhe di keyword, ottenendo in risposta una lista di link. Oggi, l’avvento dei motori di ricerca generativi (come Perplexity, Copilot o lo stesso modulo AI Overviews di Google) ha generato una “rivoluzione copernicana”: l’utente interroga la macchina in linguaggio naturale e ottiene direttamente una risposta sintetizzata, senza necessariamente dover cliccare su alcun link.

I numeri supportano questo cambiamento radicale: si stima che attualmente il 60% delle ricerche totali online non generi più alcun clic verso siti esterni, e che il 25% della Generazione Z preferisca interrogare direttamente sistemi come ChatGPT per le proprie ricerche. Di fronte a questo scenario, le strategie tradizionali mostrano forti limiti, rendendo cruciale conoscere i principi descritti nella GEO 2026.

Per i brand, questo comporta il superamento della logica basata esclusivamente sul traffico e sull’inserimento meccanico di parole chiave, spostando il focus verso un posizionamento per “topic” e la gestione del contesto. L’obiettivo strategico passa dalla mera visibilità alla costruzione di un “posizionamento cognitivo”, divenendo fonti talmente autorevoli e strutturate da essere ritenute valide, citate e usate come base dagli stessi LLM per generare le risposte agli utenti. Del Prete ha rimarcato l’importanza di tool come Perplexity in ambito di ricerca e consulenza, lodandone l’approccio trasparente che esplode in task il processo logico compiuto per arrivare al risultato e mostra chiaramente le fonti utilizzate, arginando così in modo efficace il grave problema delle “allucinazioni” algoritmiche, che porterebbero inevitabilmente a un decision making errato.

La narrazione mediatica: allarmismo, regole e la grave assenza di spirito critico

Quale ruolo giocano i media in questa complessa transizione? Paola Aragno, Vice President di Eikon Strategic Consulting Italia, ha presentato i risultati di un’indagine semantica condotta su quasi 80.000 articoli della stampa italiana. Utilizzando proprio l’AI per mappare e lemmatizzare i dati, l’analisi ha fatto emergere 7 cluster tematici dominanti che compongono “il rumore” mediatico.

- Il racconto del mercato: È il frame strutturale dominante. L’AI viene raccontata quasi esclusivamente come un fenomeno economico, uno scontro tra capitali, suscitando nel lettore ansia competitiva e urgenza economica.

- Il racconto del futuro: Caratterizzato dalla solita retorica “mitica” su innovazione e rivoluzione, ciclicamente riproposta a ogni salto tecnologico.

- Il racconto della paura: Il frame emotivo principale. La parola chiave non tecnica predominante è “lavoro”, legata ad automazione e occupazione, che trasmette fortissima ansia occupazionale a livello personale.

- Il racconto geopolitico: Dominato da Big Tech (OpenAI, Google) e dalla Cina, restituendo l’immagine di un’Europa relegata ai margini della partita tecnologica globale.

- Il racconto della conoscenza: Marginalmente presente, esplora il lato tecnico e la curiosità sui meccanismi dell’AI.

- Il racconto delle regole: In timida ma prevedibile crescita, focalizzato sul dibattito normativo e sull’AI Act.

- Il cluster assente (Scetticismo e casi concreti): Il dato più preoccupante. Nei media italiani manca quasi totalmente il racconto del dubbio, il vaglio critico delle promesse tecnologiche e l’analisi di casi di adozione reale e misurata all’interno delle aziende italiane.

La dura conclusione dell’analisi è che i media italiani, cavalcando l’allarmismo o l’euforia economica senza alimentare un vero pensiero critico, stanno abdicando al loro ruolo di informazione per limitarsi a “orientare” le percezioni collettive del pubblico su una tecnologia pervasiva e spaventosa. Aragno ha infine lanciato un avvertimento sul rischio imminente per tutti noi: a breve rischiamo di trovarci sempre più circondati da informazioni prodotte dall’AI che non sono “vere”, ma semplicemente “plausibili”, alterando in modo irreparabile la percezione della realtà.

Casi studio aziendali: operazioni, formazione e la gestione delle crisi reputazionali

A portare un esempio concreto e interno alle logiche corporate è intervenuta Caterina Ghiselli, responsabile relazioni esterne e comunicazione strategica di Telepass. L’azienda, che si muove in un contesto estremamente variegato per tipologia di target (business, consumer, flotte aziendali) e servizi (pedaggio, assicurazioni, mobilità, fintech), ha investito massicciamente sull’integrazione interna dell’intelligenza artificiale, superando le logiche di superficie.

Ad oggi, oltre il 70% della forza lavoro dell’azienda utilizza costantemente soluzioni di AI generativa integrate nei sistemi operativi, ma questo livello di adozione non è casuale: è supportato da oltre 6200 ore di formazione intensiva sull’advanced prompting per oltre metà della popolazione aziendale. Formare al prompting significa scongiurare la noia dell’operatore, evitando che la macchina restituisca output “flat”, appiattiti e non allineati all’identità o agli obiettivi del brand.

Tra i casi di successo interni sviluppati da Telepass, spicca l’implementazione dell’AI nel customer care per gestire, in modo automatizzato e con un linguaggio umanizzato, le richieste di primo livello, arginando la frustrazione degli utenti che impatta severamente sulla reputazione del marchio. Un altro filone vitale (chiamato “Atena, il blob a tre teste”) è la creazione di un hub predittivo AI che incrocia i dati dipartimentali (marketing, IT, customer care) ereditati fin dagli anni ’90 da un bacino di oltre 7 milioni di clienti, per anticipare i bisogni e definire strategie di up-selling.

Sul versante delle Relazioni Esterne, Ghiselli ha sottolineato un uso critico e difensivo dell’AI: l’analisi predittiva per il monitoraggio dei “segnali deboli”, indispensabile per intercettare minacce reputazionali prima che esplodano in casi mediatici. Un aneddoto emblematico ha riguardato un articolo totalmente allucinato pubblicato da un’autorevole testata di settore in orario serale, che diffondeva falsità su nuovi metodi di pagamento dell’azienda. L’indagine successiva ha svelato l’assenza totale di verifica delle fonti: la fake news era stata generata verosimilmente da un giornalista che aveva dato in pasto l’argomento a un LLM (probabilmente senza interrogare sistemi controllati come Perplexity), generando un “pastone” non veritiero di enorme impatto negativo.

Per mantenere saldi i pilastri di “fiducia, reputazione e autorevolezza”, l’azienda sta superando il concetto di “content factory” massiva guidata dall’AI, spostandosi verso un approccio qualitativo di brand journalism, dove la tecnologia aiuta a elevare i contenuti e i processi (come la mappatura dinamica degli stakeholder politici), ma senza mai delegare empatia, credibilità e capacità critica, prerogativa puramente umana.

Formazione, change management e il divario generazionale

La fase conclusiva dell’incontro, aperta al dibattito con il pubblico, ha toccato nervi scoperti del mercato del lavoro italiano. In primo luogo, il ritardo cronico della Pubblica Amministrazione. Di fronte all’introduzione di strumenti come Copilot (soluzioni fornite esternamente), i dipendenti over 50 hanno reagito con il “panico”, percependo l’innovazione non come un supporto produttivo, ma come un pericoloso strumento di “controllo” sul loro operato, arrivando persino a inviare richieste formali per ottenerne la rimozione.

Questo riflette una forte carenza in termini di acculturamento informatico e change management, ponendo un serio interrogativo: come comportarsi di fronte al rifiuto all’aggiornamento (re-skilling)? C’è il reale rischio di obsolescenza e demansionamento? La risposta, seppur dura, è che l’AI non rimpiazzerà l’uomo, ma “chi sa usare l’AI rimpiazzerà chi non la sa usare”. Saper usare l’intelligenza artificiale oggi non significa conoscere tecnicamente un software temporaneo, ma attivare quel pensiero critico che permette di individuare i compiti a basso valore e delegarli alla macchina, concentrandosi sul system thinking e sull’analisi degli output complessi generati (come dimostrano i giovani analisti universitari). E in questo contesto, emerge con forza l’importanza di scoprire cos’è l’intelligenza artificiale, come funziona e perché sta rivoluzionando aziende e mercati dalla base.

Conclusioni e Prospettive

Come emerso dal simposio, la luna di miele dell’intelligenza artificiale basata su hype e proclami astratti è volta al termine. Le piattaforme sono ora infrastrutture che muovono capitali enormi e necessitano di rigore scientifico, formazione continua e governance interna. Dal declassamento del piano editoriale organico sui social, alla trasformazione della SEO in GEO per posizionarsi all’interno delle risposte autogenerate dei motori AI, il digitale richiede alle aziende uno scatto di maturità. La sfida per il prossimo futuro non sarà acquistare la licenza del software più costoso, ma costruire una cultura aziendale flessibile, etica e criticamente formata, capace di gestire l’AI come si gestisce il membro più produttivo, ma meno saggio, del proprio team aziendale.

FAQ: Intelligenza Artificiale applicata a Marketing e Comunicazione

1. Perché l’85% dei progetti AI (POC) nelle aziende fallisce?

Principalmente per mancanza di un obiettivo di business reale. Molti Proof of Concept vengono avviati per puro “hype” o per migliorare l’immagine aziendale (spesso promossi in PR o su LinkedIn). Se la tecnologia non risolve un problema concreto per i dipendenti (risparmio di tempo o automazione di operazioni a basso valore) o non porta un vantaggio misurabile al CFO, viene rapidamente abbandonata.

2. Cosa significa GEO e come si differenzia dalla SEO classica?

La SEO punta a ottimizzare i contenuti per farli comparire nei risultati classici di Google (liste di link) tramite parole chiave. La GEO (Generative Engine Optimization) punta a far sì che un brand o un contenuto sia citato come fonte autorevole direttamente all’interno delle risposte discorsive generate da motori come Perplexity, Copilot o AI Overviews. Richiede un posizionamento per “argomenti e contesto”, non solo per parole.

3. Perché il classico “Piano Editoriale Social” è considerato obsoleto a causa dell’AI?

Perché la visibilità non dipende più dall’orario di pubblicazione o dall’ordine cronologico in un feed. Sono algoritmi avanzati a decidere istantaneamente, tramite calcolo probabilistico, a chi mostrare un contenuto. Serve quindi un sistema ibrido, sempre attivo (always-on) ed estremamente reattivo (real-time marketing) per cavalcare gli intenti del pubblico al momento giusto.

4. Cos’è il “Welfare AI” citato durante il convegno?

È un approccio etico e organizzativo che vede l’Intelligenza Artificiale come uno strumento per migliorare la qualità del lavoro dei dipendenti, delegando alla macchina le operazioni bruti, ripetitive e demotivanti, e permettendo all’operatore umano di focalizzarsi su compiti creativi e ad alto valore strategico.